Insights

AI-Ready Data: Zlatá horečka AI versus realita datové infrastruktury velkých firem

24 července, 2025

Vedení každé společnosti požaduje AI. Boardroomy rezonují pojmy jako kopiloti a asistenti. Realita? Milionové investice do datových jezer, které se v éře Generativní AI staly úzkým hrdlem. Projekty uvízly v pekle pilotních projektů. Proč?

Drsná pravda (The Harsh Truth) je, že na základě výzkumů lze hlavní příčinu neúspěšných AI implementací vysledovat nikoli k omezením modelů nebo nedostatku výpočetního výkonu, ale k nedostatečné připravenosti dat (inadequate data readiness) v podkladových datových sadách. Stávající datová architektura jednoduše nebyla navržena pro potřeby umělé inteligence. Tento fundamentální nesoulad je největší brzdou skutečné transformace.

Predikce společnosti Gartner je neúprosná: do roku 2026 selže a bude opuštěno více než 60 % AI projektů v organizacích, které nezavedou praxi AI-ready dat. K překonání této bariéry je nutné pochopit kořen problému, tedy proč tradiční přístupy selhávají.

Problém: Selhání tradiční datové infrastruktury v éře AI

Strategický význam pochopení, proč moderní datové platformy, navržené pro Business Intelligence (BI), selhávají při podpoře AI, nelze podcenit. Jádro problému nespočívá v technologii samotné, ale v jejím historickém účelu. Tyto systémy byly optimalizovány pro lidské uživatele a historické reportování, což je zásadně odlišný způsob práce s daty, než jaký vyžadují moderní AI agenti.

Iluze připravenosti (The Illusion of Readiness)

Iluze připravenosti je mylné přesvědčení, že vlastnictví moderních datových jezer, skladů a katalogů automaticky znamená připravenost na AI. Firmy by měly být „na papíře“ připravené, protože investovaly obrovské prostředky do své datové infrastruktury. V praxi se však tyto platformy stávají úzkým hrdlem (bottleneck). Když přijde požadavek na nový AI use case, vytvoření správného datového pohledu stále trvá měsíce. To vede k frustraci AI týmů, které nemohou inovovat, a k netrpělivosti byznysu, který nevidí slibovanou návratnost investic.

Šest kritických mezer: Proč platformy postavené pro BI selhávají

Tradiční datová architektura selhává kvůli šesti kritickým mezerám, které odhalují její fundamentální nekompatibilitu s požadavky AI:

- Omezení v přípravě dat (Data preparation limitations): Tradiční datové sklady jsou optimalizovány pro historické reportování, nikoli pro spotřebu dat umělou inteligencí v reálném čase. AI vyžaduje dynamické, specializované a rychle dostupné datové sady, což je v rozporu s architekturou navrženou pro statické, agregované reporty.

- Omezená podpora nestrukturovaných dat (Limited unstructured data support ): Třicet let zaměření na strukturovaná data způsobilo, že nejcennější podnikové znalosti – obsažené v dokumentech, smlouvách, e-mailech a zprávách – zůstávají uvězněny a pro AI nedostupné.

- Mezery ve správě dat (Governance gaps): Požadavky na compliance pro AI jsou zásadně odlišné od těch pro BI. Zatímco BI se soustředí na integritu dat pro reporty, pro AI jsou vysvětlitelnost (explainability), rodokmen dat (lineage) a auditovatelnost naprosto nepostradatelnými požadavky pro zajištění důvěryhodnosti autonomních rozhodnutí a souladu s regulacemi.

- Chybějící evaluační rámce (Missing evaluation frameworks): Tradiční platformy postrádají systematický způsob, jak testovat přesnost a spolehlivost AI vůči konkrétním obchodním požadavkům. Právě tato mezera brání pilotním projektům splnit obchodní SLA a je hlavním důvodem, proč Gartner predikuje selhání více než 60 % projektů.

- Problém přetížení kontextem (Context overload problem): Přesnost AI dramaticky klesá, když se dotazuje masivních, nefiltrovaných datových jezer. Problém vzniká z nadměrné irelevance, kdy je AI agent zahlcen obrovským množstvím dat, a z faktu, že AI nedokáže pochopit kontext bez sémantického obohacení. To vede k nespolehlivým výsledkům.

- Neflexibilní datové pohledy (Inflexible data views): Jak jsme již uvedli, vytváření specializovaných datových sad pro konkrétní případy použití AI trvá měsíce, nikoli dny. Tato pomalost znemožňuje agilní vývoj a nasazování AI řešení.

K překonání těchto fundamentálních mezer je potřeba přijmout tři nové architektonické pilíře, které posunou datovou strategii do éry umělé inteligence.

Tři pilíře řešení: Architektonický posun k AI Ready Data

Řešení výše uvedených problémů nespočívá v revoluci a nahrazení stávajících systémů. Jde o jejich evoluci – rozšíření o nové vrstvy navržené specificky pro potřeby AI. Představujeme tři klíčové architektonické pilíře, které umožní transformovat stávající datovou infrastrukturu na vysoce výkonný motor pro umělou inteligenci.

Pilíř 1: Paradigma “AI Ready Data” (pro strukturovaná data)

Základní princip paradigmatu AI Ready Data je jednoduchý, ale transformační: Místo dotazování obrovských datových jezer v naději na přesnost je nutné připravit izolované, menší datové sady optimalizované pro specifické případy použití AI. Tímto přístupem řešíme problém přetížení kontextem a neflexibilních datových pohledů.

Klíčové požadavky pro dosažení stavu AI-ready zahrnují:

- Příprava dat specifická pro daný use case: Data musí být připravena s ohledem na konkrétní potřeby AI a musí obsahovat vestavěné evaluační datové sady, které umožňují kontinuálně měřit výkon a přesnost modelu.

- Specializovaná API a pohledy: Je nutné vytvářet rozhraní, která poskytují AI agentům pouze čistá, relevantní a auditovatelná data. Tím se zabrání jejich zahlcení irelevantními informacemi a ochrání se core systémy.

- Správní rámce (Governance Frameworks): Tyto rámce musí být navrženy pro AI a zahrnovat testovací datové sady, ověřené testovací odpovědi a pokrytí regulačních požadavků, aby byla zajištěna vysvětlitelnost a soulad s předpisy.

- Kontinuální kvalifikace dat: Data musí být průběžně ověřována, aby si udržela relevanci a kvalitu v souladu s neustále se vyvíjejícími obchodními potřebami. Tím je zajištěn persistentní stav připravenosti pro AI.

Pilíř 2: Model Context Protocol (MCP) (pro legacy systémy)

Mnoho firem řeší „The Legacy Anchor“ (Kotva starých systémů), kdy jsou kritická data uvězněna v systémech jako je například COBOL a mainframy. Integrace AI s těmito systémy je extrémně nákladná a složitá. Například API těchto systémů nejsou navržena pro dotazy ve stylu AI – umí odpovědět na dotaz na cenu jedné akcie, ale selžou při dotazu typu „ukaž mi všechny společnosti, jejichž akcie včera vzrostly o více než 10 %“.

Řešením je Model Context Protocol (MCP) – abstrakční vrstva fungující jako „AI-Ready API“. Lze si ji představit jako číšníka: AI agent (host) se nehrne do kuchyně (starý systém), ale sdělí svůj požadavek číšníkovi (MCP). Číšník ví, jak tento požadavek přeložit do jazyka, kterému rozumí kuchyně, a přinese přesně to, co bylo objednáno.

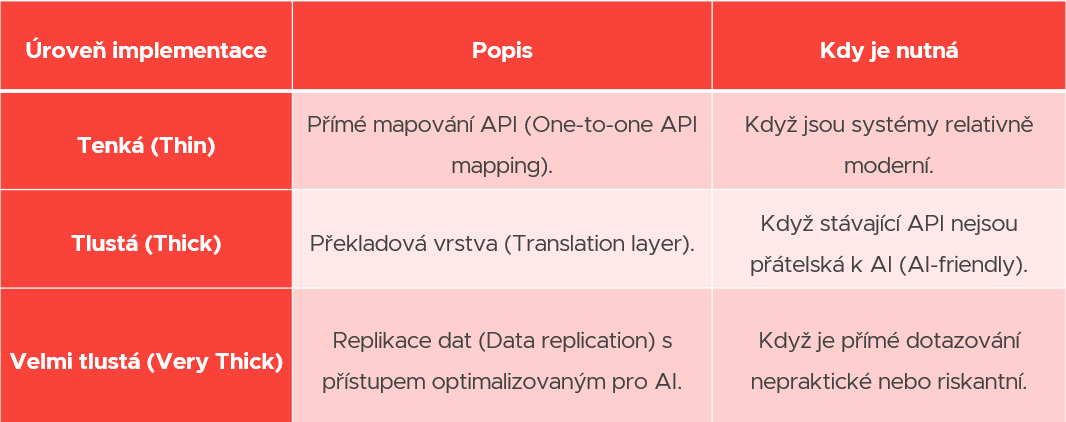

Implementace MCP se liší podle míry nekompatibility starého systému:

Pilíř 3: Reprezentace znalostí (Knowledge Representation) (pro nestrukturovaná data)

Nejcennější firemní znalosti se často neskrývají v tabulkách, ale v dokumentech, e-mailech a zprávách. Tento problém, nazývaný „The Unstructured Tsunami“ (Tsunami nestrukturovaných dat), vede ke „Knowledge Crisis“ (Znalostní krizi), která má kořeny ve 30 letech, kdy se firmy začaly zaměřovat z 90 % na strukturovaná data. Tradiční přístupy, jako je jednoduché rozsekání a vložení textu (chunk-and-embed) v RAG systémech, často selhávají, vedou k halucinacím a ztrátě důvěry. Důvodem je, že AI na rozdíl od člověka nedokáže pochopit kontext bez sémantického obohacení.

Řešením je Reprezentace znalostí – nová, nezbytná znalostní vrstva nad datovou vrstvou. Poprvé v historii potřebujeme vrstvu znalostí nad datovou vrstvou, aby AI mohla být skutečně úspěšná.

Klíčové komponenty tohoto řešení jsou:

- Sémantické obohacení (Semantic Enrichment): Surový text je obohacen o kontext a význam. Například místo uložení holého textu patentu systém přidá informaci: „Tento patent používá metodu genetické modifikace X z regionu USA“.

- Znalostní grafy (Knowledge Graphs): Tyto grafy strukturují vztahy mezi entitami (např. Metoda X → související patenty → regionální variace), což AI umožňuje provádět přesné, kontextuální dotazy.

- Hybridní strategie vyhledávání (Hybrid Retrieval): Kombinace filtrace na základě metadat, vektorového vyhledávání a vrstvy uvažování (reasoning layer) překonává limity tradičního RAG a poskytuje přesné, spolehlivé a auditovatelné odpovědi.

Tyto tři pilíře nejsou oddělené koncepty. Jejich skutečná síla se projeví, až když se spojí v jednotném architektonickém řešení.

Řešení a vize: Architektura znalostního jezera (Knowledge Lake)

Skutečná síla pro Generativní AI nevzniká z jednotlivých pilířů izolovaně, ale z jejich inteligentního propojení. Vize Znalostního jezera (Knowledge Lake) představuje další evoluční krok podnikové datové architektury, který integruje všechny tři pilíře do soudržného celku.

Společná vrstva: Sémantické obohacení jako klíč k úspěchu

Průnikem mezi paradigmatem AI Ready Data a Reprezentací znalostí je vrstva sémantického obohacení (Semantic Enrichment Layer). Toto je místo, „kde se čistá, řízená data setkávají s významem (meaning)“. Právě tato vrstva je skutečným motorem (enablerem) Generativní AI. Tím, že propojuje ověřená data s kontextem, umožňuje AI asistentům stát se důvěryhodnými, vysvětlitelnými a v souladu s předpisy (compliant).

Komponenty architektury Znalostního jezera

Znalostní jezero nenahrazuje stávající datová jezera, ale představuje jejich evoluci. Dochází k zásadnímu posunu: od poskytování surových dat pro analytické nástroje k poskytování strukturovaných znalostí pro AI systémy.

Architektura Znalostního jezera se skládá z následujících hlavních komponent:

- Fázovaná strukturovaná a nestrukturovaná data ze stávajícího datového jezera.

- Přístupové vrstvy MCP (tenké/tlusté) pro bezpečnou integraci s legacy systémy.

- Znalostní grafy se sémantickým obohacením jako centrální prvek pro ukládání kontextu a vztahů.

- Anotace metadat propojující všechny vrstvy a zajišťující konzistenci.

- Specializované úložiště pro data relevantní pro governance a evaluaci (testovací sady, verzionované prompty, ověřené odpovědi).

- Perzistentní úložiště pro paměť AI agentů a auditní stopy jejich rozhodování.

Důkazy z praxe: Případové studie

Následující příklady nejsou teoretické koncepty. Jde o reálná řešení, která vyřešila konkrétní podnikové problémy díky implementaci principů AI-ready dat a ukázala cestu, jak uniknout z „pekla pilotních projektů“.

Případová studie: Globální banka (výzva strukturovaných dat)

- Problém: Globální banka čelila situaci, kdy legacy systémy (COBOL, mainframy) a neflexibilní datový sklad způsobovaly, že integrace každého nového AI use casu trvala měsíce. Tato extrémní režie a pomalost bránily jakýmkoli inovacím.

- Řešení: Byla implementována dedikovaná datová platforma, která efektivně oddělila (decoupled) AI iniciativy od core systémů. Byly vytvořeny specializované API (praktická realizace MCP), které poskytovaly AI modelům pouze čistá, relevantní a auditovatelná data. Součástí řešení bylo zavedení robustního governance frameworku s testovacími sadami pro zajištění souladu s regulacemi.

- Výsledek: Klíčovým obchodním dopadem bylo dramatické zrychlení dodávky AI projektů z měsíců na týdny. To umožnilo nasazení několika klíčových AI řešení (např. risk scoring, sumarizace transakcí) do produkčního provozu, což dříve nebylo možné.

Případová studie: Investiční společnost (výzva nestrukturovaných dat)

- Problém: Analytici investiční společnosti se potýkali se zpracováním masivních a komplexních finančních zpráv. Tradiční metody RAG (chunk-and-embed) kompletně selhaly, generovaly nespolehlivé odpovědi a vedly k hluboké frustraci a ztrátě důvěry v AI.

- Řešení: Bylo zavedeno hybridní vyhledávání, které kombinovalo vektorové vyhledávání s uvažováním nad celými dokumenty (full-document reasoning). Klíčovou roli hrála vrstva Reprezentace znalostí, která datům dodala potřebný sémantický kontext a přesnost. Protokol MCP byl navíc použit k překonání slabých API třetích stran, odkud byla data čerpána.

- Výsledek: Došlo k transformaci od frustrace k důvěře. Odpovědi generované AI se staly spolehlivými, kompletními a plně auditovatelnými, což analytikům výrazně zefektivnilo práci a zvýšilo kvalitu jejich výstupů.

Obchodní přínosy a výsledky

Přechod na architekturu AI-ready dat není jen technické cvičení. Je to strategický krok, který přináší konkrétní, měřitelnou a udržitelnou obchodní hodnotu napříč celou organizací.

Pět klíčových obchodních výsledků

- Návratnost investic do stávající infrastruktury (ROI): Tento přístup konečně umožňuje monetizovat milionové investice do datových skladů a jezer i mimo tradiční reporting. Stávající datové zdroje se stávají základem pro vysoce hodnotné AI aplikace.

- Rychlost uvedení na trh (Speed to market): Nasazení nových AI use cases se zrychluje z řádu měsíců na týdny. Podniky tak mohou rychleji reagovat na tržní příležitosti a inovovat před konkurencí.

- Zmírnění rizik (Risk mitigation): Zavedením správné governance, robustních testovacích a evaluačních rámců se zajišťuje spolehlivost, bezpečnost a předvídatelnost AI systémů, což je klíčové pro jejich nasazení v kritických podnikových procesech.

- Konkurenční výhoda: Odemknutí hodnoty z dosud nevyužitých nestrukturovaných dat poskytuje přístup ke znalostem, které konkurence nemá. Tato informační asymetrie se stává zdrojem trvalé konkurenční výhody.

- Soulad s regulacemi (Regulatory compliance): Architektura s vestavěnou vysvětlitelností a rodokmenem dat (lineage) zajišťuje plnou auditovatelnost a soulad s přísnými předpisy, jako je například EU AI Act.

Strategický posun v myšlení

Tento přístup vyžaduje strategický posun v tom, jak o datech a AI přemýšlíme. Klíčové principy jsou:

- Nenahrazovat, ale rozšiřovat a vyvíjet stávající datový ekosystém.

- Nepřebudovávat, ale tvořit AI-ready vrstvy nad existujícími systémy.

- Nečekat, ale začít budovat tyto schopnosti inkrementálně a zaměřit se na rychlé výhry.

Tímto způsobem se vaše stávající datová infrastruktura konečně promění v AI engine, kterým měla vždy být.

Výzva k akci: Váš plán na první čtvrtletí

Úspěch s AI není o modelech samotných, ale o systematickém budování datových základů. Následující kroky představují praktický a akční plán, jak uniknout z „pekla pilotních projektů“ a začít budovat škálovatelná AI řešení.

Týden 1: Proveďte nekompromisní audit

Proveďte audit své stávající datové architektury oproti třem pilířům (AI Ready Data, MCP, Knowledge Representation) a identifikujte největší slabiny. Audit by měl odpovědět na následující otázky:

- Které případy použití AI uvízly kvůli úzkým hrdlům v přípravě dat?

- Jaká kritická data jsou uvězněna ve starých systémech a brání inovacím?

Měsíc 1: Identifikace rychlých výher s nejvyšší hodnotou

Na základě auditu identifikujte nejhodnotnější příležitosti, které přinesou rychlý a viditelný dopad. Zaměřte se na následující:

- Která integrace starého systému pomocí MCP může odemnknout nejvíce AI use cases?

- Jaký nestrukturovaný datový zdroj obsahuje nejcennější obchodní znalosti, které lze odemknout pomocí Reprezentace znalostí?

- Který stávající AI pilot by mohl jít do produkce, pokud by měl k dispozici správné datové základy?

Čtvrtletí 1: Vybudování první AI-ready schopnosti

Přetavte identifikované příležitosti v konkrétní výsledky. Stanovte si za cíl vybudovat první funkční komponentu vaší nové architektury:

- Implementujte MCP server pro nejkritičtější legacy systém.

- Vytvořte vrstvu Reprezentace znalostí pro nejhodnotnější nestrukturovaná data.

- Zaveďte první evaluační datové sady pro kontinuální měření kvality a spolehlivosti AI.

Závěr: Budoucnost patří AI-nativním datovým prostředím

Hlavní myšlenka je jasná: Přestaňte nutit tradiční datovou architekturu, aby sloužila AI. Začněte budovat datová prostředí, která jsou nativní pro AI, která udržují persistentní stavy připravenosti pro AI a zároveň škálují firemníiniciativy.

Společnosti, které toto pochopí jako první, nebudou mít jen lepší AI – budou mít AI, která skutečně funguje v podnikovém měřítku a přináší reálnou hodnotu.

Otázkou je: budete to vy?